Byla vydána nová stabilní verze 24.05 linuxové distribuce NixOS (Wikipedie). Její kódové označení je Uakari. Podrobný přehled novinek v poznámkách k vydání. O balíčky se v NixOS stará správce balíčků Nix.

Byla vydána nová verze 1.48.0 sady nástrojů pro správu síťových připojení NetworkManager. Novinkám se v příspěvku na blogu NetworkManageru věnuje Fernando F. Mancera. Mimo jiné se v nastavení místo mac-address-blacklist nově používá mac-address-denylist.

Před 25 lety, 31. května 1999, započal vývoj grafického editoru Krita (Wikipedie). Tenkrát ještě pod názvem KImageShop a později pod názvem Krayon.

Farid Abdelnour se v příspěvku na blogu rozepsal o novinkám v nejnovější verzi 24.05.0 editoru videa Kdenlive (Wikipedie). Ke stažení brzy také na Flathubu.

David Revoy, autor mj. komiksu Pepper&Carrot, se rozepsal o své aktuální grafické pracovní stanici: Debian 12 Bookworm, okenní systém X11, KDE Plasma 5.27, …

Wayland (Wikipedie) byl vydán ve verzi 1.23.0. Z novinek lze vypíchnout podporu OpenBSD.

Craig Loewen na blogu Microsoftu představil novinky ve Windows Subsystému pro Linux (WSL). Vypíchnout lze GUI aplikaci pro nastavování WSL nebo správu WSL z Dev Home.

V sobotu 1. června lze navštívit Maker Faire Ostrava, festival plný workshopů, interaktivních činností a především nadšených a zvídavých lidí.

Webový server Caddy (Wikipedie) s celou řadou zajímavých vlastností byl vydán ve verzi 2.8 (𝕏). Přehled novinek na GitHubu.

Byla vydána verze 3.0 (@, 𝕏) svobodného softwaru HAProxy (The Reliable, High Performance TCP/HTTP Load Balancer; Wikipedie) řešícího vysokou dostupnost, vyvažování zátěže a reverzní proxy. Detailní přehled novinek v příspěvku na blogu společnosti HAProxy Technologies.

get_all_articles.py vám stiahne z Wikipedie všetky názvy slovenských článkov.LANGUAGE = "sk"

a do main_categories stačí vložiť názvy kategórí z hlavnej stránky Wikipedie v danom jazyku.cat list/list.txt | wc -l 215128

sort list/list.txt | uniq -c | sort -nr | head

545 Imagine_Peace_Tower

189 Super_Jamato_(trieda_lodí)

189 Rimava_(rieka)

174 Slaná

165 Sovetskij_Sojuz_(trieda_lodí)

165 Scharnhorst_(trieda_lodí)

165 Jamato_(trieda_lodí)

165 Bismarck_(trieda_lodí)

163 Šinano_(lietadlová_loď)

157 Cirocha

Možno existuje nejaké elegantnejšie riešenie pre stiahnutie článkov z Wikipedie, ale neviem o ňom.

Takže som si extrahoval len unikátne názvy:

awk '!seen[$0]++' list/list1.txt > list/list-uniq.txtPočet jedinečných článkov je v skutočnosti 15723.

cat list/list-uniq.txt | wc -l 15723

download.py.

Všetky články sa sťahujú do priečinku articles. Ak sa z nejakého článku nepodarí extrahovať text,

tak sa zaloguje do errors/error_save_article.txt. (články sa u mńa práve sťahujú)echo Dom | ./majka -f w-lt.sk.fsa dom:k1gInSc1 dom:k1gInSc4 dom:k1gInSc5 dom:kATo nám to vypľuje, že je to Substantivum, rod mužsḱý neživotný, číslo jednotné v páde 1, 4 a 5. Do ľudského jazyka si to dekódujete pomocou tejto nápovedy.

Ale napríklad sa dá vyskúšať

miniature GPT

, LSTM, alebo čo vás napadne.

Najviac sa tešim, že by to mohlo celkom dobre fungovať, so slovnými druhmi + LSTM a nejaké hranie sa s tým.

Momentálne mám v pláne iné veci, ale chcel som si pripraviť aspoň nejaké dáta.

Ale napríklad sa dá vyskúšať

miniature GPT

, LSTM, alebo čo vás napadne.

Najviac sa tešim, že by to mohlo celkom dobre fungovať, so slovnými druhmi + LSTM a nejaké hranie sa s tým.

Momentálne mám v pláne iné veci, ale chcel som si pripraviť aspoň nejaké dáta.

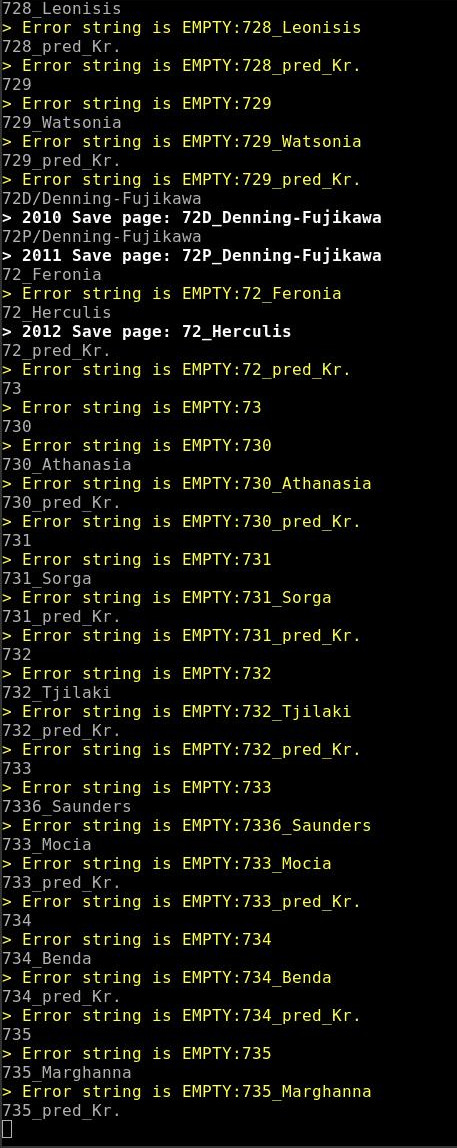

get_all_articles_special.py a stiahol 307149 názvov strániek. Na záver sa zacyklil , takže som skript musel vypnúť ručne. Nemajú to vyvhytané, pretože posledná stránka sa opakuje stále dookola. Teraz sa stánky sťahujú, mno kopec z nich sú obsahovo prázdne, ako je vidieť na obrázku nižšie.

Tiskni

Sdílej:

![]()

![]()

![]()

![]()

![]()

![]()

To je najlepšie.

Stiahneš: stiahneš

Výpis a spracovanie (nič extra ťažké): wiki.openzim.org/wiki/Zimlib

bliká to jako když vomylem máčknu banner s čínskou reklamou :O :O :D ;D

nóó tak vod nás angelinu pozdravuj :D ;D

Na záver sa zacyklil , takže som skript musel vypnúť ručne. Nemajú to vyvhytané, pretože posledná stránka sa opakuje stále dookola.Majú vychytané. Viď poslednú stránku toho zoznamu.

Teraz sa stánky sťahujú, mno kopec z nich sú obsahovo prázdne, ako je vidieť na obrázku nižšie.Ak dáš tie a la prázdne stránky editovať, tak zistíš, že nie sú prázdne. Máš označené, že prázdná stránka, ale tá stránka má a la užitočný text pre používateľa (myslený text vľavo v článku).

na nvidii nejlíp :D ;D

Mno jelikoz ses evidentne debil, kterej neumi stahnout databazi, a pripadne si ji nalejt do vlastni instance mediawikiNechcem si inštalovať softvér ktorý nebudem používať. Uvítal by som klasické zipko všetkých stránok. Niečo som dal teraz sťahovať, ale netuším čo v ňom bude (https://dumps.wikimedia.org/backup-index.html). Inak používam knižnicu, ktorá používa officiálne Wikipedia API, takže to robí trafic medzi 50 - 100kbit/s. To robím väčší DDOS, keď si pustím niečo na YT. 99% požiadaviek aj tak vybaví keš.

).

Nicmene, porizeni/sestaveni vhodnych vstupnich dat je asi nejslozitejsi cast vsech AI projektu. Takze je jasne, ze na tom nejaky cas stravis.

).

Nicmene, porizeni/sestaveni vhodnych vstupnich dat je asi nejslozitejsi cast vsech AI projektu. Takze je jasne, ze na tom nejaky cas stravis.